Сергей Кравцов, сооснователь и СЕО Evergreen делится с читателями liga.net своим мнением относительно гос регулирования искусственного интеллекта в Украине и мире.

Исследование проведенное Center for the Governance of AI, Future of Humanity Institute, University of Oxford показало что американские граждане в целом не полностью доверяют ИИ и хотят ввести регуляцию ИИ на законодательном уровне.

Как осторожно говорят сами авторы исследования “Наши результаты дают предварительное представление о характере общественного мнения в США в отношении ИИ. […] Наши выводы ставят больше вопросов, чем дают ответов; они, скорее, наводят на размышления”. И это в целом отражает ситуацию как в США, так и в других странах. Ниже подробнее о сомнениях, стратегиях и гос.инициативах в области ИИ и роботов, а также об инициативах ЕС в области искусственного интеллекта.

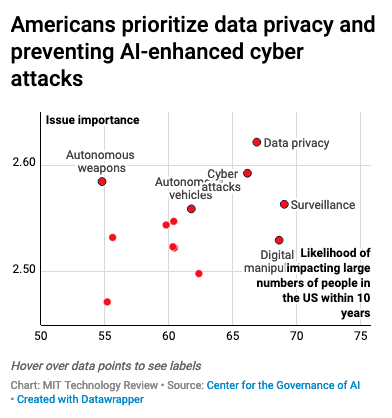

По мнению американских граждан самое важное и затронет больше всего людей? На первых местах по возможности воздействия на их жизни находятся личные данные, кибератаки и автономное оружие, а по массовости воздействия это слежка за людьми, манипуляция данными и снова-таки приватность.

82% респондентов считают что разработкой и уже разработанными алгоритмами/роботами в сфере искусственного интеллекта нужно управлять с осторожностью. При этом наибольшим доверием пользуются технологические компании, государственные службы и военные.

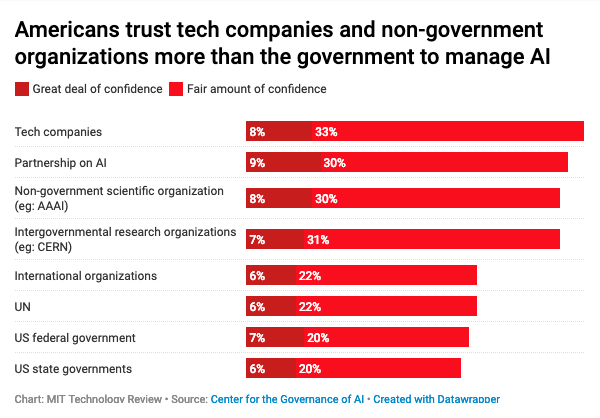

На вопрос кому стоит доверить управление ИИ, американцы утверждают: лучше всего если ИИ будут управлять технологические компании, возможно, в партнерстве с государством, или же негосударственные или международные организации.

Контроль за ИИ американцы скорее доверили бы частным хайтех-компаниям и негосударственным организациям,

чем правительству (больше информации на диаграмме по ссылке)

Отметим также, что в США Комитет Палаты представителей по вооруженным силам принял решение о создании Комиссии национальной безопасности по искусственному интеллекту, но пока этот орган больше направлен на анализ и оценку рисков, преимущественно в военной сфере.

А как обстоят дела с перспективой государственной регуляции ИИ в мире?

Многие правительства представили национальные политики и стратегии в области искусственного интеллекта, которые подчеркивают их осведомленность в вопросах этических проблем в области искусственного интеллекта, а также приверженность разработке безопасных и полезных технологий искусственного интеллекта.

Стратегии Великобритании, Франции, Канады, Индии в основном содержат в себе призывы «учитывать экономические, этические и социальные последствия достижений в области искусственного интеллекта» и рекомендуют открытое законодательство о защите данных, переносимости данных и доверии к данным. Британская стратегия помимо этого отмечает, что «крупные компании, которые контролируют огромные объемы данных, не должны становиться чрезмерно мощными», а французская предусматривает «недопущение непрозрачной приватизации ИИ или его потенциально деспотического использования».

В Китае существует Национальный стандарт сбора персональных данных, в котором рассматриваются вопросы, аналогичные тем, которые содержатся в Общих положениях Европейского союза о защите данных (GDPR). В июле 2017 года Государственный совет КНР опубликовал подробную стратегию по превращению Китая к 2030 году в «лидера и глобальный центр инноваций в области искусственного интеллекта». Она включает в себя обещания инвестировать в исследования и разработки, которые «будут укреплять с помощью ИИ национальную оборону, обеспечивать и защищать национальную безопасность».

В это же время Правительственная Военно-промышленная комиссия РФ поставила главной целью роботизировать 30% военной техники к 2025 году. О госрегулировании или этике речь пока не идет.

В общем на сейчас правительственные службы разных стран больше говорят о необходимости разработки каких-то законов, чем готовы реально регулировать ИИ на законодательном уровне.

В ноябре в 2018 года в Брюсселе прошла конференция “Правовые и нормативные последствия искусственного интеллекта (AI): кейсы автономных транспортных средств, электронного здравоохранения и сбора данных”, на которой обсуждались этические и регуляторные нормы в области ИИ. В материалах конференции упоминается достаточно много интересных инициатив, из которых мы отметим две.

AI HLEG – High-Level Expert Group on Artificial Intelligence – после открытого процесса отбора Европейская Комиссия назначила 52 эксперта в новую группу экспертов высокого уровня по искусственному интеллекту, в состав которой входят представители научных кругов, гражданского общества и промышленности. Подробнее об этой комиссии и её целях можно прочитать здесь. В сущности AI HLEG будет служить руководящей группой для работы Европейского альянса AI, взаимодействовать с другими инициативами, помогать строить диалог с участием заинтересованных сторон, собирать мнения участников и отражать их в своих отчетах.

Платформа European AI Alliance - Европейский альянс по искусственному интеллекту. Его цель - сформировать широкую многостороннюю платформу, которая будет дополнять и поддерживать работу экспертной группы высокого уровня, в частности по подготовке проектов руководящих принципов этики, а также обеспечению конкурентоспособности Европейского региона в растущей области искусственного интеллекта. К платформе можно присоединиться, и после одобрения вашей заявки вы сможете принять участие в обсуждении и формировании будущей регуляторной политики в области искусственного интеллекта.

Члены Альянса могут участвовать в дискуссиях друг с другом и экспертами AI HLEG на специальном форуме. Также будет запрошена обратная связь по конкретным вопросам, а также по проектам документов, подготовленных AI HLEG в рамках раздела, посвященного этому. Европейская комиссия планирует провести свою первую ежегодную конференцию Альянса AI в 2019 году. Членство в Альянсе предоставит привилегированный доступ к этому событию. Более подробная информация о мероприятии будет опубликована на платформе AI Alliance.

В качестве заключения, можно сказать, что пока правительства всего мира “выражают глубокую озабоченность” и декларируют “необходимость следовать этическим нормам”, фактически ИИ может развиваться свободно. Но чтобы в один прекрасный день не проснуться в мире антиутопии, законодательное регулирование роботов и ИИ должно быть введено. И чем раньше это произойдет, тем лучше. Мы в Evergreen в свою очередь присоединились к инициативе European AI Alliance для совместного создания регуляторных норм AI и Robotics.